Künstliche Intelligenz – wir bringen Ihnen die Technologie näher

Ein Auto, ein Computer, ein Wesen? In der amerikanischen 80er-Jahre Kultserie "Knight Rider" ist das sprechende und hochtechnisierte Wunderauto K.I.T.T. von zentraler Bedeutung. Die Künstliche Intelligenz K.I.T.T. spricht und trifft eigenständig Entscheidungen, um dem Hauptcharakter Michael Knight beim Kampf für Recht und Gesetz zur Seite zu stehen. In der Serie hinterfragt dabei niemand die ethischen Aspekte, die mit der Eigenständigkeit einer Künstlichen Intelligenz einhergehen.

Beim Wunderauto K.I.T.T. handelt es sich um eine sogenannte starke KI, d.h. ein künstliches System mit einer dem Menschen ähnlich generellen Intelligenz. Im Gegensatz zum Film gibt es aktuell ausschließlich schwache KI-Systeme. Die schwache KI dient der effizienten Lösung von speziellen Aufgaben (z.B. Schach spielen, medizinische Diagnosen oder Textübersetzung). Sie verfügt außerhalb dieser spezifischen Funktion über keine weiteren Fähigkeiten.

Künstliche Intelligenz sicher nutzen: KI begegnet uns immer öfter im Alltag. Auf Ihrem Smartphone sind Sie vermutlich bereits mit KI in Berührung gekommen. In dieser Broschüre geben wir elf Handlungsempfehlungen für eine möglichst sichere Nutzung von Künstlicher Intelligenz.

Einsatz und Training von KI-Systemen

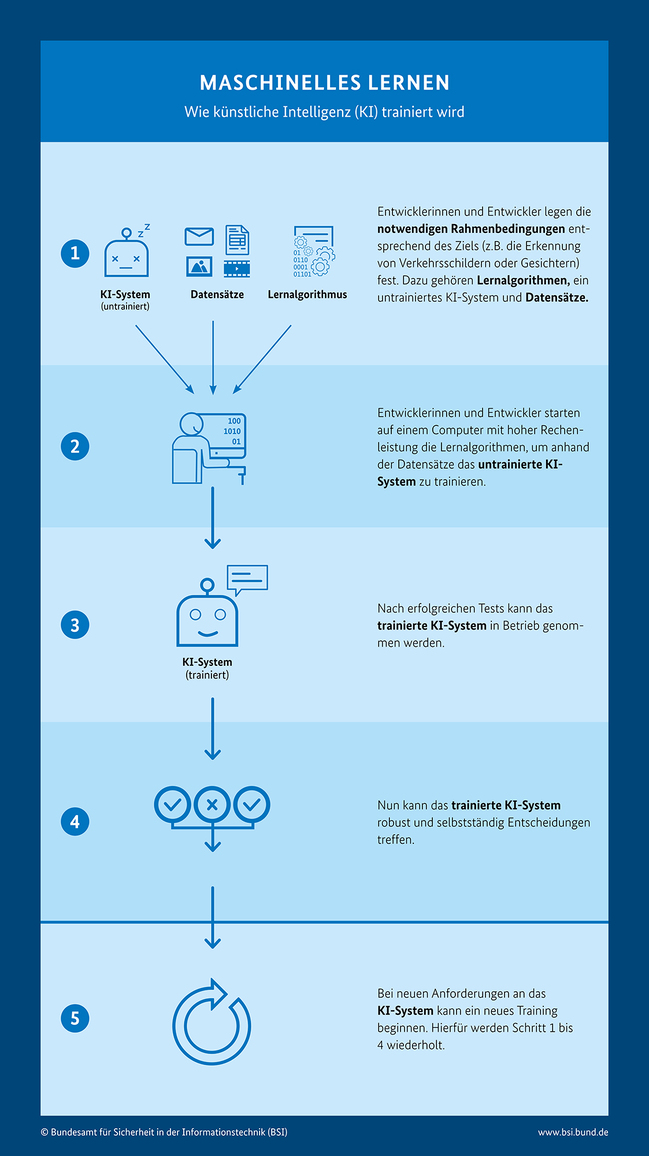

Künstliche Intelligenz (KI) ist ein Oberbegriff für Methoden, die auf die Automatisierung von Entscheidungsvorgängen abzielen, die traditionell den Einsatz menschlicher Intelligenz erfordern. Der Einsatz und die Verwendung von KI-Systemen erfordern die Diskussion von essentiellen Fragestellungen: Können Algorithmen zum Beispiel so trainiert werden, dass sie ethisch tragbare Entscheidungen treffen? Das Training von KI-Systemen benötigt große Datensätze und im Betrieb von KI-Systemen werden oftmals persönliche Daten verarbeitet. Wie kann hierbei ein rechtlich und technisch ausreichender Datenschutz gewährleistet werden?

Zur Beantwortung dieser Fragen müssen die Funktionsweise und die Entscheidungen von KI-Systemen interpretierbar und evaluierbar gemacht werden. Nur so können die Vorzüge dieses Technikpotentials in Zukunft sicher genutzt werden.

Das Training von KI-Systemen benötigt große Mengen an Daten

KI-Systeme benötigen zum Aufbau ihrer Lösungskompetenz mittels maschinellen Lernens große Mengen an Daten, d.h. KI-Systeme können immer nur so gut sein wie die zum Training benutzten Daten. Durch ihre inhärente Fähigkeit zu generalisieren, können KI-Systeme auch Eingabedaten verarbeiten, die nicht in den Trainingsdaten vorkommen. Je stärker sich die Eingabedaten jedoch von den Trainingsdaten unterscheiden, desto wahrscheinlicher werden Fehlinterpretationen durch das KI-System.

Gesichtserkennung funktioniert zum Beispiel nur dann präzise und robust, wenn das zugrunde liegende KI-System mit sehr vielen hochwertigen, diversen und breitgefächerten Gesichtsbildern trainiert und immer wieder getestet wurde. Dafür benötigen die Entwicklerinnen und Entwickler oft viele Durchläufe. Danach kann das KI-System Entscheidungen über neue Datensätze treffen und z.B. Gesichter erkennen. Um neuartige Eingabedaten zuverlässig verarbeiten zu können, müssen KI-Systeme mittels neuer Daten nachtrainiert werden.

Dies wäre z.B. der Fall, wenn ein Gesichtserkennungssystem, das bisher nur für Erwachsene entwickelt wurde, nun auch Gesichter von Kindern erfassen soll. Die im Betrieb eines KI-Systems erhobenen Daten können, soweit es die Datenschutzbestimmungen zulassen, für weitere Verbesserungen des Systems genutzt werden.

Die Grundlage für die Lernfähigkeit eines KI-Systems bildet neben den verfügbaren Trainingsdaten die Struktur des zugrunde liegenden KI-Systems. Dazu zählen z.B. ausgewählte neuronale Netze und verschiedene maschinelle Lernverfahren wie Deep Learning. Diese Rahmenbedingungen legen die Entwicklerinnen und Entwickler vor dem Training fest und justieren sie während des Trainings so lange nach, bis das KI-System die geforderte Aufgabe, z.B. die Gesichtserkennung, wie gewünscht erfüllt.

KI-Systeme können je nach Aufgabe mit unterschiedlichen Daten trainiert werden. Dazu gehören u.a. Bilddaten zur automatischen Gesichtserkennung oder Gesundheitsdaten für die medizinische Diagnose, wie z.B. Röntgenaufnahmen. Wenn es darum geht, verschiedene Datenquellen effizient zu verknüpfen, spielen KI-Systeme eine weitere Stärke aus: So hängen Entscheidungen beim autonomen Fahren u.a. von Daten über den Zustand des eigenen Fahrzeugs (z.B. Geschwindigkeit), Umgebungsbedingungen (Wetter, Kamerabilder, Entfernungssensoren) oder der Verkehrssituation ab.

Die Generierung neuer Daten aus verschiedenen Datenquellen ist sowohl Chance als auch Herausforderung für den Datenschutz. Dies gilt beispielsweise dann, wenn aus weniger schützenswerten Metadaten personenbezogene Daten, die einem besonderen Schutz unterliegen, ableitbar sind.

Schnell wird klar, wie umfangreich und komplex Datenpakete sein können, die für das maschinelle Lernen benötigt werden. Entscheidend ist jedoch nicht nur der Umfang der Daten, sondern auch die Qualität, um unerwünschte Entscheidungsmuster bei einer KI auszuschließen.

Deepfakes - Gefahren und Gegenmaßnahmen

Sogenannte Deepfakes nutzen die Fähigkeiten Künstlicher Intelligenz, um etwa Gesichter oder Stimmen in Video- und Audioaufzeichnungen oder auf Fotos zu fälschen. Damit können zum Beispiel Videos von prominenten Persönlichkeiten gefälscht werden, in denen sie Aussagen treffen, die sie in der Realität nie ausgesprochen haben. Solche Methoden zur Manipulation von Identitäten können dazu dienen, biometrische Systeme zu überlisten oder Desinformationskampagnen durchzuführen und Unwahrheiten zu verbreiten. Auf unserer Themenseite finden sich zahlreiche Informationen zum Thema Deepfake sowie interessante Beispielaufnahmen.

Im Video erklärt der BSI-Experte, was Deep Fakes sind und wie man sie erkennt.

Fehlinterpretationen Künstlicher Intelligenz

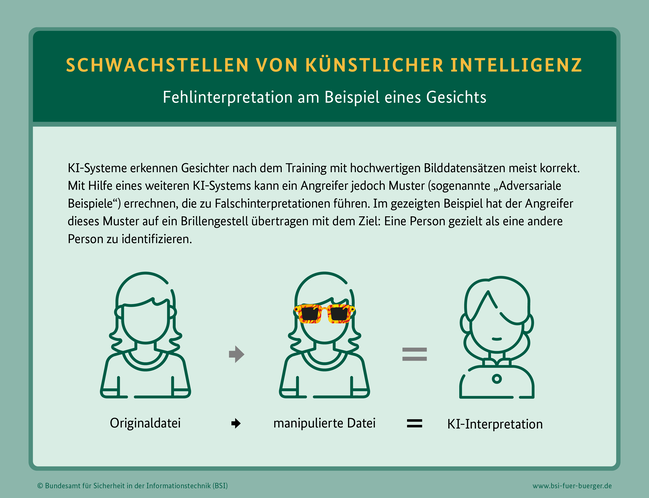

Bei jedem KI-System kann es zu Fehlinterpretationen neuer Dateneingaben kommen. Wie wahrscheinlich dies ist, hängt im Wesentlichen von der Qualität und Quantität der Trainingsdaten ab. Neben zufälligen Fehlfunktionen können Angreifer gezielt nach Eingabedaten suchen, die dann zu (gezielten) Fehlentscheidungen führen. Dazu wird dem Bild beispielsweise eine Störung in Form eines Rauschmusters hinzugefügt, die für die menschliche Wahrnehmung unauffällig ist, aber bei KI-Systemen zu einer Entscheidungsänderung führt (siehe Grafik). So kann es zu einer Fehlinterpretation bei der Erkennung von Gesichtern oder beim Erkennen von Straßenschildern kommen. Jedes KI-System ist diesbezüglich anfällig. Bisher sind diese Fehlinterpretationen für externe Prüferinnen und Prüfer sowie die KI-Entwicklerinnen und -Entwickler nur schwer nachvollziehbar.

Auch die Diskriminierung bestimmter Personengruppen (u.a. ethnischer Minderheiten) bei KI-Entscheidungen ist häufig auf unzureichende bzw. unausgewogene Trainingsdatensätze zurückzuführen: In einem bekannt gewordenen Fall in der IT-Branche hat ein KI-basierter Bewerbungsalgorithmus unbeabsichtigt Frauen benachteiligt. Weil es in der Tech- bzw. IT-Branche mehr Männer als Frauen gibt und insofern auch eine eher männlich dominierte Bewerberlage vorherrscht, hat das KI-System gefolgert, dass Männer mehr Interesse an dem Arbeitgeber haben und sich mehr für das Unternehmen begeistern als Frauen. Daher filterte es die Bewerbungen von Frauen eher aus und benachteiligte sie damit.

Diese Schlussfolgerung des KI-Systems ist natürlich als falsch zu bewerten, da die herangezogenen Bewerberzahlen keine Aussage über fehlendes Interesse der sich bewerbenden Frauen zulassen. Das Ergebnis des KI-Systems würde das zahlenmäßige Übergewicht der männlichen Beschäftigten immer weiter verstärken. Der Bewerbungsalgorithmus wurde deshalb anschließend mit dieser zusätzlichen Information trainiert und dadurch hinsichtlich einer besseren Fairness korrigiert. Das Beispiel zeigt, wie wichtig es ist, dass die intelligenten KI-Systeme nachvollziehbar werden, um Interpretationslücken vorab zu schließen.

Künstliche Intelligenz sicher entwickeln

KI-Systeme bergen enorme Potenziale. So sind ohne Künstliche Intelligenz viele moderne Anwendungen nicht denkbar:

- Vorhersagen anhand großer Datenmengen, z.B. Wetter, Börsenkurse, Erdbeben

- Kontextbasierte Suchen im Internet

- Sprachassistenten

- Biometrische Authentifizierung mit Gesichtserkennung und Fingerabdrücken

- (Teil-)Autonomes Fahren zur automatischen Steuerung des Autos im Straßenverkehr

- Adaptive (lernfähige) Abwehr von Cyberangriffen

- Automatisierte Diagnose von Krankheiten anhand von Bilddaten (z.B. Radiologie)

Für den sicheren Einsatz von KI und um Fehlinterpretationen der KI-Systeme im Betrieb zu vermeiden, ist es wichtig, den Entscheidungsprozess eines KI-Systems vollumfänglich zu verstehen und sichtbar zu machen. Hierfür muss der Gesamtprozess aus Trainingsdatengenerierung, maschinellem Lernen und Betrieb des KI-Systems betrachtet werden.

Darüber hinaus gilt es, Fragen zur Informationssicherheit von KI-Systemen zu beantworten:

- Welche Daten werden bei den Anwendungen übertragen und wohin?

- Wie wird sichergestellt, dass aus dem KI-System nicht persönliche Daten extrahiert werden können?

- Wie wird sichergestellt, dass das KI-System nicht versehentlich persönliche Daten ausgibt?

- Wie sicher sind persönliche Daten, die von KI-Systemen genutzt werden?

- Wie können die Entscheidungen von KI-Systemen für Benutzerinnen und Benutzer nachvollziehbar sein?

- Wie werden Cyberkriminelle KI nutzen?

All diese Fragen müssen zukünftig beantwortet werden, um mit entsprechenden Richtlinien und Standards den Einsatz von Künstlicher Intelligenz, einer der Kerntechnologien der Zukunft, sicher zu gestalten.

Newsletter: Einfach • Cybersicher - das monatliche BSI-Update

Mit dem Newsletter "Einfach • Cybersicher" erhalten Verbraucherinnen und Verbraucher regelmäßig Informationen zu wichtigen Ereignissen rund um ihre Cybersicherheit und zu aktuellen Sicherheitslücken. Neben praktischem Wissen enthält der Newsletter den multimedialen Trainingsteil "Macht euch cyberfit!" zu wechselnden Themen des digitalen Alltags. Zum Newsletter "Einfach • Cybersicher".

- Kurz-URL:

- https://www.bsi.bund.de/dok/12776368