Biometrie als KI-Anwendungsfeld

Einleitung

Biometrische Verfahren zur automatisierten Erkennung von Personen sind ein vielversprechender Ansatz zur Authentifizierung von Personen, der neben herkömmlichen Methoden wie PIN/Passwort und Karte oder anderen Token in zunehmendem Maße eingesetzt wird. Ziel einer biometrischen Erkennung ist stets, die Identität einer Person zu ermitteln (Identifikation) oder die behauptete Identität zu bestätigen beziehungsweise zu widerlegen (Verifikation).

Im Folgenden wird das Biometrie-Evaluations-Zentrum (BEZ) vorgestellt, in welchem das BSI biometrische Systeme hinsichtlich ihrer Performanz, Schwachstellen und Usability untersucht.:

Die biometrische Erkennung kann dabei anhand unterschiedlicher Modalitäten durchgeführt werden. Das können etwa Fingerabdruck oder Gesicht sein. Aufgrund ihrer sehr guten Performanz stellen KI-Modelle zunehmend Kernfunktionalitäten bei der biometrischen Erkennung bereit. Konkret werden sie beim Abgleich neu erfasster biometrischer Daten mit zuvor gespeicherten Referenzdaten eingesetzt. Die KI trifft Entscheidungen, ob Referenzdaten und neu erfasste Daten zur selben Person gehören. Hierfür kommen insbesondere Verfahren wie neuronale Netze auf Basis von Algorithmen des maschinellen Lernens (ML) zum Einsatz.

Dennoch sind mit dem Einsatz von KI-Modellen eine Reihe von Risiken verbunden. Sie können insbesondere über KI-spezifische Angriffe attackiert werden. Umgekehrt können KI-Verfahren auch selbst für Angriffe im Kontext Biometrie verwendet werden, so etwa zur Erzeugung sogenannter Deepfakes. Die vielfältigen Beziehungen zwischen KI und Biometrie hat das BSI in dem Überblicksartikel "The Interplay of AI and Biometrics: Challenges and Opportunities" dargestellt.

KI in der Biometrie: Lebenszyklus

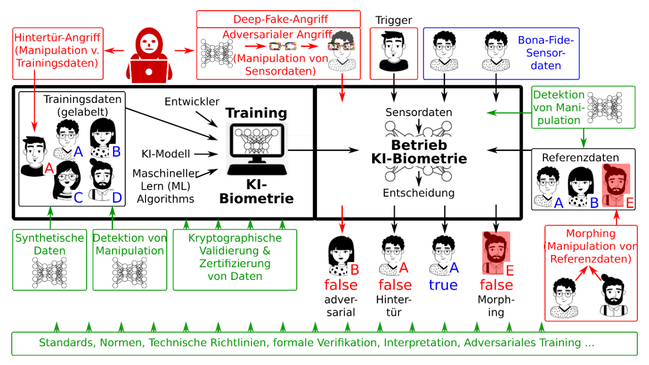

Die Abbildung stellt in kompakter Form den Lebenszyklus eines biometrischen Verfahrens am Beispiel der Gesichtsbiometrie dar. Mit Trainingsdaten (Abb., linker Teil) trainiert ein Entwicklungsteam das KI-Modell darauf, einerseits unterschiedliche Aufnahmen eines Gesichts auch derselben Person zuzuordnen sowie andererseits die Aufnahmen der Gesichter verschiedener Personen zu unterscheiden. Die Trainingsdaten sind Gesichtsaufnahmen, die mit der Identität der zugehörigen Person annotiert (gelabelt) sind. Qualität und Quantität der Trainingsdaten beeinflussen wesentlich die spätere Performanz des Modells. Hierbei spielt auch die Abdeckung aller für den Wirkbetrieb zu erwartenden Merkmalsausprägungen, insbesondere hinsichtlich Alter, Geschlecht und Herkunft, eine fundamentale Rolle. Wird das KI-Modell im Wirkbetrieb auf Personengruppen angewendet, die innerhalb der Trainingsdaten nicht ausreichend repräsentiert waren (Bias), so weist es für diese Gruppen eine (unter Umständen deutlich) schlechtere Performanz auf.

Nach der Trainingsphase wird das KI-Modell in den Wirkbetrieb überführt. Im Wirkbetrieb müssen Nutzerinnen und Nutzer zunächst mittels Referenzdaten (Abb. rechts) im System registriert werden (Enrolment), bevor das KI-Modell zur biometrischen Erkennung dieser Gruppe verwendet werden kann. Das System vergleicht über einen Sensor aufgenommene Gesichtsaufnahmen mit den vorhandenen Referenzdaten (1:N-Identifikation). Als Ergebnis gibt es die Identität der zu den Aufnahmen gehörenden Person aus (Abb., rechter Teil). Je nach Anwendungszweck und alternativ zur 1:N-Identifikation kann eine 1:1-Verifikation einer Live-Aufnahme mit den Daten jeweils eines spezifischen Ausweisdokuments durchgeführt werden.

KI-spezifische Angriffe

Möglichkeiten für KI-spezifische Angriffe bieten sich sowohl in der initialen Trainingsphase als auch während des Wirkbetriebs. Diese Angriffe sind dabei nicht spezifisch für den Anwendungsfall der biometrischen Erkennung, sondern können auch KI-Modelle treffen, die für andere Zwecke verwendet werden. Eine Übersicht und grundsätzliche Aussagen zu KI-spezifischen Angriffen und Gegenmaßnahmen hat das BSI im Dokument „Sicherer, robuster und nachvollziehbarer Einsatz von KI“ zusammengestellt.

Poisoning-Angriffe manipulieren Trainingsdaten des KI-Modells, um eine von den Entwicklungsteams nicht vorgesehene Reaktion auf (bestimmte) Eingaben zu erzeugen. Im Spezialfall des Hintertürangriffs werden die Trainingsdaten so manipuliert, dass das KI-Modell eine vom Angreifer gewünschte Ausgabe erzeugt, wenn die Eingabe ein spezielles, nur dem Angreifer bekanntes Muster (Auslöser/Trigger) enthält (Abb., oben links und Mitte).

Bei adversarialen Angriffen verleiten Angreifende das KI-Modell durch eine Manipulation der Eingabedaten im Wirkbetrieb zu nicht von den Entwickelnden vorgesehenen Ausgaben. Bei gezielten Angriffen legen sie die Ausgabe explizit fest. Ungezielte Angriffe verursachen lediglich eine nicht vorgesehene Ausgabe. Ob gezielt oder nicht: Das Modell selbst wird bei dieser Angriffsmethode nicht verändert. Bereits geringfügige Änderungen der Eingabedaten können bedeutsame Auswirkungen haben. Solche Änderungen sind schwierig zu detektieren und selbst für Menschen nicht unmittelbar erkennbar – oder werden als irrelevant interpretiert. Im Kontext der Gesichtserkennung kann ein adversarialer Angriff beispielsweise das Tragen einer Brille mit speziell bedrucktem Gestell oder eines speziellen Mützenaufnähers sein (Abb., oben mittig).

Doppelrolle: KI auch als Angriffswerkzeug

Morphing-Angriffe sind nicht KI-spezifisch, beruhen jedoch zunehmend selbst auf der Nutzung von KI-Verfahren. Beim Morphing manipuliert der Angreifer hinterlegte Referenzdaten: Die Gesichtsbilder mehrerer Personen werden so miteinander verschmolzen, dass das entstehende Bild Merkmale all dieser Personen enthält. Dadurch kann das biometrische Verfahren Gesichtsbilder von jeder dieser Personen erfolgreich mit den per Morphing erstellten Referenzdaten abgleichen (Abb., rechts).

Deepfakes: Verfahren zur Manipulation medialer Identitäten

Verfahren zur Manipulation von medialen Identitäten existieren seit vielen Jahren. Allerdings haben diese insbesondere durch Verbesserungen auf dem Gebiet der tiefen neuronalen Netze deutlich an Qualität gewonnen und der benötigte manuelle Aufwand für eine solche Fälschung ist merklich gesunken. Aufgrund der Nutzung von tiefen neuronalen Netzen werden solche Verfahren umgangssprachlich auch als „Deepfakes“ (siehe auch Abb. über adversarialer Angriff) bezeichnet. Mit Hilfe von Deepfake-Methoden ist es unter anderem möglich, Gesichter in Videos und Stimmen in Audiodaten qualitativ hochwertig zu manipulieren.

Mittels dieser Verfahren ist es auch für den technisch versierten Laien möglich, mediale Identitäten zu manipulieren, um beispielsweise Fernidentifikationssysteme zu überwinden, Personen zu verleumden, Betrugsdelikte zu begehen (z.B. „CEO-Fraud“) oder Falschnachrichten zu erstellen.

Gegenmaßnahmen

Nach derzeitigem Stand können Angreifer, die ihre Methoden adaptiv an verwendete Gegenmaßnahmen anpassen, nicht effektiv abgewehrt werden. Dennoch können Gegenmaßnahmen den Aufwand für erfolgreiche Angriffe erhöhen.

Poisoning-Angriffe lassen sich durch Verfahren zur Detektion von Manipulationen der Trainingsdaten abwehren. Diese können einerseits in der Nutzung kryptografischer Verfahren zur Sicherung der Integrität der verwendeten Trainingsdaten über die gesamte Lieferkette bestehen. Andererseits gibt es Verfahren wie forensische Analysemethoden oder Interpretationsverfahren, um manipulierte Daten gezielt zu erkennen (Abb. Lebenszyklus eines KI-Systems in der Gesichtsbiometrie links unten). Ein weiterer komplementärer Ansatz liegt in der Nutzung selbst erzeugter synthetischer Gesichtsdaten. Dies reduziert die Abhängigkeit von externen, potenziell korrumpierten Datenquellen. Dies kann auch deshalb von Nutzen sein, da die Verwendung externer biometrischer Daten gemäß der DSGVO aufgrund ihrer besonderen Schutzbedürftigkeit mit Hindernissen verbunden ist.

Um adversariale Angriffe zu verhindern, können zum einen Verfahren zur Detektion von Manipulationen der Eingabedaten eingesetzt werden (Abb. Lebenszyklus eines KI-Systems in der Gesichtsbiometrie rechts). Zum anderen lassen sich die Trainingsdaten im Rahmen eines adversarialen Trainings dahingehend anreichern, dass sie dem KI-Modell die Entwicklung einer höheren Robustheit ermöglichen (Abb. Lebenszyklus eines KI-Systems in der Gesichtsbiometrie unten).

Verfahren zur Detektion von Manipulationen können auch im Kontext der Verhinderung von Morphing-Angriffen eingesetzt werden (Abb. Lebenszyklus eines KI-Systems in der Gesichtsbiometrie rechts).

Da KI-spezifische Angriffe und Gegenmaßnahmen Gegenstand der aktuellen Forschung sind, liegen relevante Standards, Normen oder technische Richtlinien mit Maßnahmen, die ein konkretes Sicherheitsniveau gewährleisten können, bisher nicht vor oder befinden sich noch in Erstellung. Das BSI ist darin aktiv involviert.

Projekt BIOLAB:

Mit der fortschreitenden Digitalisierung in hoheitlichen und kommerziellen Anwendungen gewinnt die Authentisierung von Benutzern zunehmend an Bedeutung. Die Biometrie ist dabei eine nutzerfreundliche und dadurch immer beliebtere Technologie.

Mit steigender Nutzung von biometrischen Authentisierungsverfahren steigt gleichermaßen der Bedarf an Performanz, Sicherheit und Handhabbarkeit dieser biometrischen Systeme gleichermaßen für hoheitliche Anwendungen wie der Grenzkontrolle als auch für den Einsatz in immer mehr Bereichen für Wirtschaft und Gesellschaft, wie Online-Banking und eGovernment-Anwendungen. Hier ist das BSI besonders gefordert biometrische Systeme angemessen evaluieren und neue Entwicklungen zur Verbesserung der Sicherheit und Zuverlässigkeit gestalten zu können.

Dazu hat sich das BSI mit dem Projekt „BIOLAB“ einen Rahmen geschaffen, um die Evaluation hoheitlicher und kommerzieller biometrischer Systeme sowie angewandte Forschung und Entwicklung in dem von der Hochschule Bonn-Rhein-Sieg (H-BRS) neu aufgebauten Biometrie-Evaluations-Zentrum (BEZ) auf dem Campus in Sankt Augustin durchzuführen.

Weitere Informationen über das BEZ und die aktuellen Aktivitäten im BIOLAB-Projekt finden Sie auf den folgenden Projektseiten: